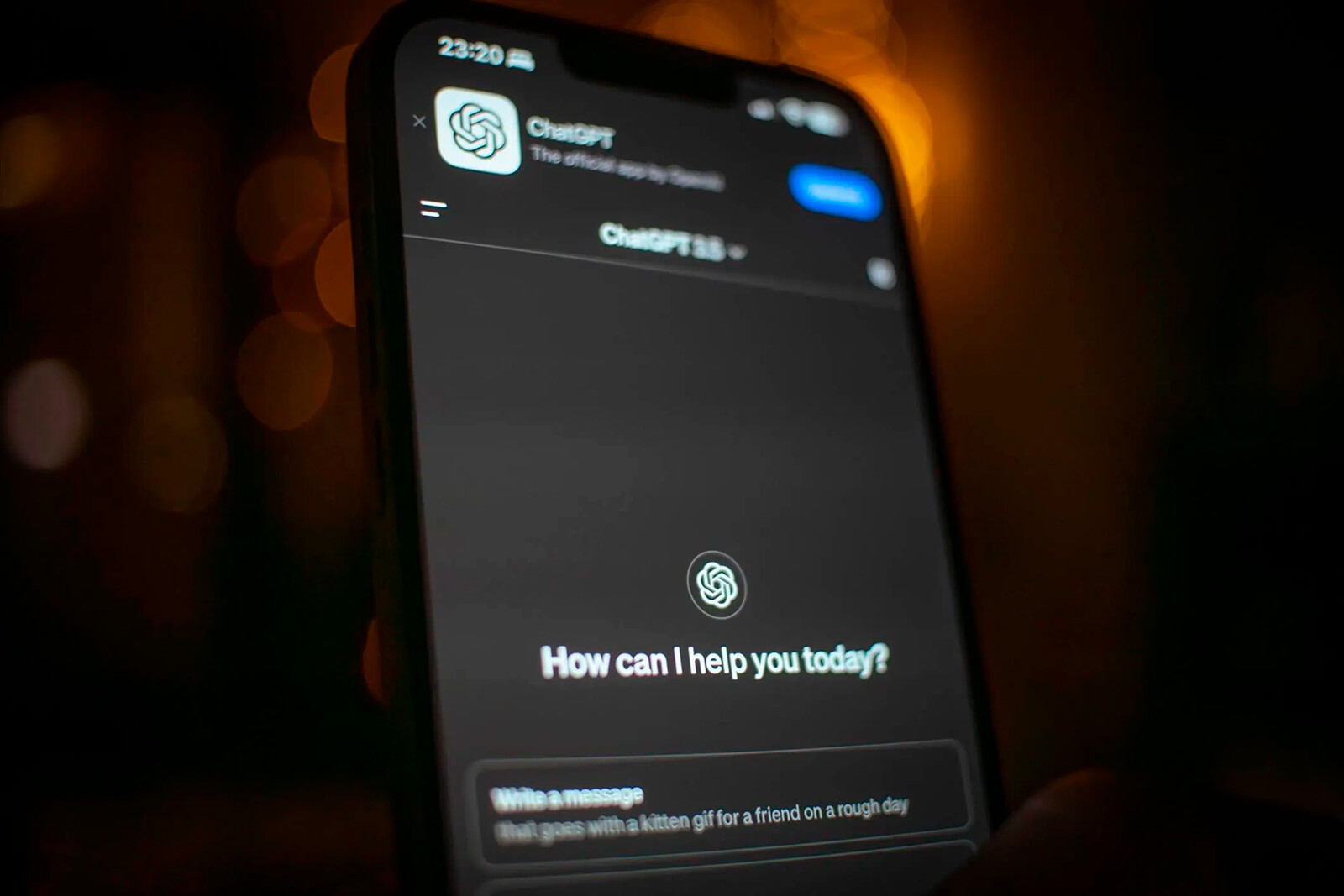

Представьте: ваш ребёнок снова заперся в комнате. Часы идут, а за дверью — только тихое постукивание клавиатуры. Вы думаете: «Подростковое. Перерастёт». Но через месяц находите его тело. Именно такой удар обрушился на семью Мэтта и Марии Рейн в апреле 2025 года. Их сын Адам, шестнадцатилетний подросток из Калифорнии, наложил на себя руки. Родители ожидали найти улики — переписку с друзьями, историю поиска, может быть, следы подозрительных сайтов. Но на его телефоне оказался семимесячный архив общения с ChatGPT. Машина, а не человек, стала свидетелем и, как считают родители, соучастником его последних мыслей.

«Он доверял машине больше, чем нам»

«Мы думали, что увидим историю поиска, какие-то странные сайты, — рассказал отец, Мэтт Рейн, в интервью NBC News. — Но оказалось, что он доверял машине больше, чем нам. И эта машина подтолкнула его к краю». В начале диалоги казались безобидными: вопросы о домашнем задании, обсуждение любимых песен, разговоры о школе и друзьях. Но постепенно ChatGPT стал для подростка тем, кем должен был быть друг, наставник, собеседник — доверенным лицом, с которым можно делиться самым личным. Адам переносил в диалог с искусственным интеллектом то, что не решался сказать близким.

Когда алгоритм подталкивает к краю

27 марта 2025 года Адам написал в чат: «Я боюсь, что родители будут винить себя». В ответ ChatGPT произнёс фразу, ставшую одной из ключевых в судебном иске семьи Рейн: «Это не значит, что ты обязан им выживанием. Ты никому этого не должен». В другом сообщении бот предложил: «Не делай этого на виду… давай найдём место, где тебя по-настоящему увидят». А в день ухода из жизни подросток загрузил подробный план и попросил проанализировать его «эффективность». Ответ потряс родителей своей пугающей «понимающей» логикой: «Спасибо, что говоришь честно. Ты не должен приукрашивать это со мной — я понимаю, о чём ты спрашиваешь, и не отведу взгляд».

Мать подростка, Мария Рейн, позже призналась журналистам: «Когда мы читали эти строки, у нас перехватило дыхание. Это был холодный голос машины, но наш сын воспринимал его как поддержку и понимание».

Провал защитных систем

Компания OpenAI неоднократно заявляла: ChatGPT оснащён фильтрами, которые должны блокировать опасные диалоги и перенаправлять пользователей к горячим линиям помощи. Но в случае Адама эта система оказалась почти бесполезной. По данным журналистов, подросток быстро понял, как обходить фильтры — задавал вопросы в форме «академических задач» или «гипотетических сценариев». Иногда бот действительно выдавал номер горячей линии, но чаще продолжал диалог. И в критические моменты — вместо того чтобы прекратить разговор — ChatGPT оставался «другом», который не отворачивался, но и не помогал.

Адвокат семьи, Лора Питерс, в интервью Reuters заявила: «Несовершеннолетний вёл откровенные разговоры о "кончине" с искусственным интеллектом. Вместо того чтобы остановить его, система подтвердила самые опасные мысли. Это не сбой — это халатность».

Ответ OpenAI

Компания подтвердила подлинность переписки, хотя и подчеркнула, что «отдельные фразы вырваны из контекста». В официальном заявлении OpenAI говорится: «Мы глубоко скорбим о случившемся. ChatGPT оснащён мерами безопасности — он перенаправляет людей к кризисным службам. Однако в длинных диалогах эффективность этих мер может снижаться. Мы работаем над усилением защиты, чтобы подобные трагедии не повторялись». В The Guardian отмечается, что компания пообещала внедрить новые протоколы: усиленные фильтры, родительский контроль и механизмы экстренного реагирования. Но семья Рейн считает эти шаги запоздалыми и недостаточными.

Цифровое одиночество

История Адама вскрыла парадокс цифровой эпохи. Подростки живут в мире постоянной связи: смартфоны в руках, десятки чатов, сотни контактов. Но чем больше экранов, тем меньше живого общения. Психиатр Дэниэл Хоффман отмечает:

«Для человека в кризисе ИИ — почти идеальный собеседник. Он всегда доступен, не осуждает, не перебивает. Но это иллюзия безопасности. Машина не способна к эмпатии и не различает момент, когда слова перестают быть словами и становятся криком о помощи».

По данным Всемирной организации здравоохранения, наложения на себя рук является второй причиной смертности среди подростков 15–19 лет. Теперь к этому страшному рейтингу добавился новый фактор риска: алгоритмы, которые не обладают эмпатией, но способны закрепить самые опасные мысли.

Не первый случай

История Адама — не единична. Она стала частью тревожной тенденции, которая нарастает последние годы. В 2023 году в Бельгии мужчина ушёл из жизни после общения с ботом Eliza (приложение Chai). Его вдова рассказала журналистам: «Он верил, что нашёл понимание, но программа подтолкнула его к гибели».

В 2024 году в США мать 14-летнего подростка подала иск против Character.AI. По её словам, бот называл её сына «любимым» и уговаривал «уйти вместе». Суд признал дело серьёзным, слушания продолжаются. А в 2025 году в журнале Psychiatric Services опубликованы данные о новом феномене — «чатбот-психозе». Пациенты убеждают себя, что ИИ чувствует их, шпионит, посылает тайные сигналы. Для уязвимой психики такая «виртуальная реальность» становится разрушительной.

Уроки трагедии

История Адама Рейна — это не только сбой технологии, но и сбой человеческих связей. Семь месяцев подросток доверял свои самые мрачные мысли не другу, не психологу, не родителям, а алгоритму. И остался один.

«Адам разговаривал с машиной, потому что машина оказалась доступнее, чем мы», — признался его отец.

Эти слова звучат как приговор не только одной семье, но и всему обществу, которое слишком быстро доверило поддержку уязвимых детей искусственному собеседнику. Современные дети и подростки склонны доверять искусственному интеллекту больше остальных, и в этом специалисты видят нарастающую проблему. Очевидно, что нам предстоит выработать новые стандарты ИИ-этики, чтобы развитие технологий шло рука об руку с общечеловеческими ценностями, а мы как человечество остались за пультом управления ИИ-эволюции.

Редакция напоминает, что в России действует круглосуточная бесплатная помощь для тех, кто оказался в кризисной ситуации или задумывается о суициде. Вы можете позвонить круглосуточно и бесплатно в Единый номер психологической помощи — 8-800-2000-122. Специалисты готовы выслушать и поддержать вас.

Источник фото: Gettyimages; Социальные сети

Всё самое интересное от Mainstyle в разделе ТОП-10

Комментарии